Blog

PFNは2016年10月4-6日に千葉幕張メッセで開催されたCEATEC2016で、スマートピッキングロボットおよびバラ積みロボットの展示を行ってきました。ロボットの他にもドローンやDIMoに関する展示も一緒に行いました。こちらに関しては関連記事をご参照ください。

以下では、もう少し詳細な解説をしたいと思います。

展示内容

我々PFNが今年の7月に参加したAmazon Picking Challenge 2016で用いたピッキングロボットに改良を加えたスマートピッキングロボットと、バラ積みロボットを用いたキャンディ配りロボットを展示しました。

スマートピッキングロボットは、UIで指定されたアイテムを棚からカゴへ取ったり、

逆にカゴから棚にアイテムを戻すことができます。また、全自動で連続運転する自動モード機能やドローンと連携してアイテムを運搬するといった機能も開発しました。

キャンディ配りロボットはPFNオリジナルキャンディを、バラ積みロボットを用いて来場者の方に配布しました。

技術的な背景

- スマートピッキングロボット

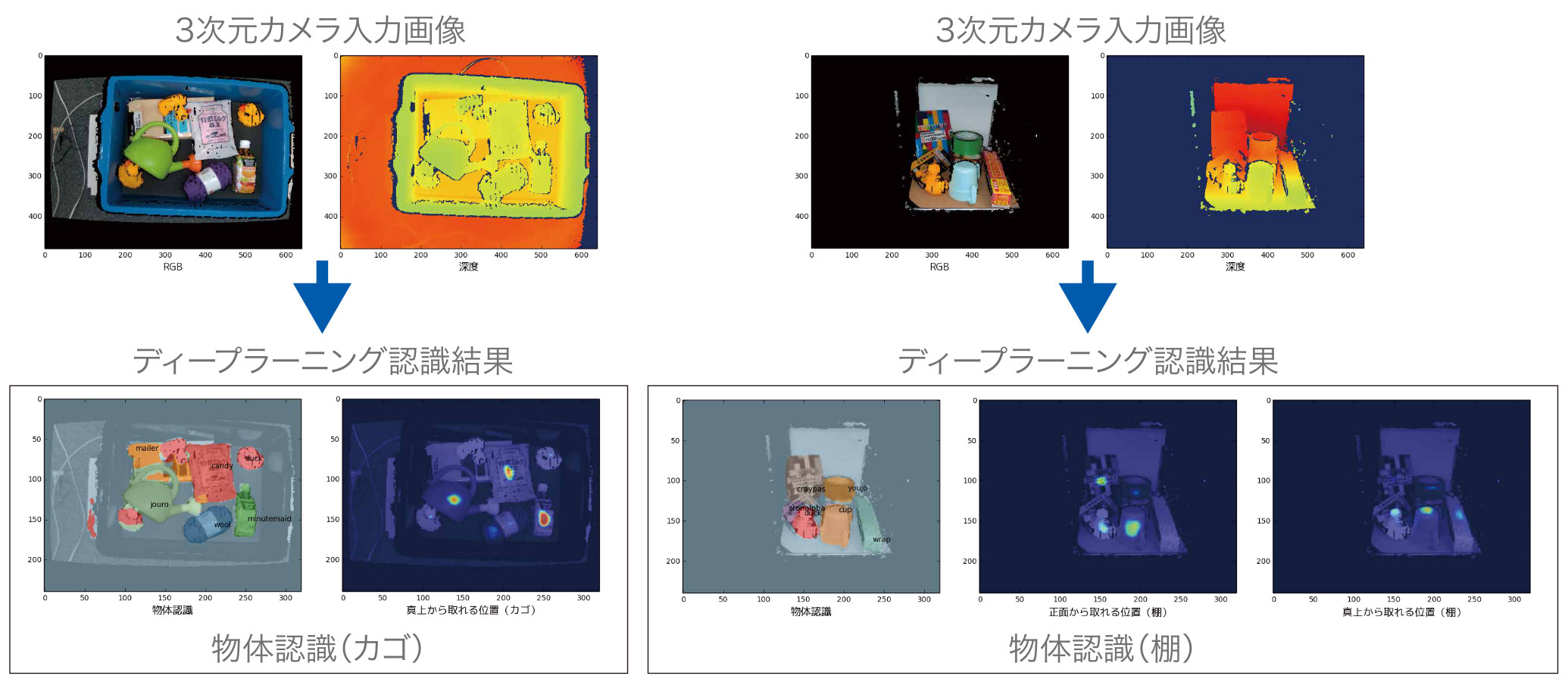

今回展示したピッキングロボットはディープラーニングを用いて、カラーカメラ及びデプスセンサの情報から「どこにどのアイテムが有るのか」「どこにロボットアームでアプローチすれば取れるのか」をそれぞれ学習させています。

今回のタスクは複数の物体が乱雑に置かれており、物体が他の物体に隠れる様なオクルージョンが多く、布やビニールのような変形する物体も含まれており、古典的な画像処理手法では対処が難しい問題です。我々は、ディープラーニングを用いたSemantic Segmentationという手法をベースにすることで、このような難しい環境下でも高精度に動作するシステムを実現しました。

「どこにどのアイテムが有るのか」という課題に対しては、今回は30種類のアイテムを事前に学習させた、17層のCNNを作りました。このCNNは入力画像の各ピクセルに対し、そこがどの物体に属するのかを予測することが出来ます。これにより、どの領域にアームを持っていけば、目標の物体に当てられるかが判断できます。

次に、目標物体の領域の内どこが「取れる」領域(平らな面など)で、どこが「取れない」領域(箱の角など)なのかを判断する必要があります。そこで、「どこにアプローチすれば取れるのか」もCNNに学習させました。このCNNは「手前に物体があるので取りにくい」といった複雑な判断も、ある程度学習しています。これにより、指定されたアイテムが直接取れない場合は他のアイテムを先に取り出してから目的のアイテムを取り出すといった事が可能になります。

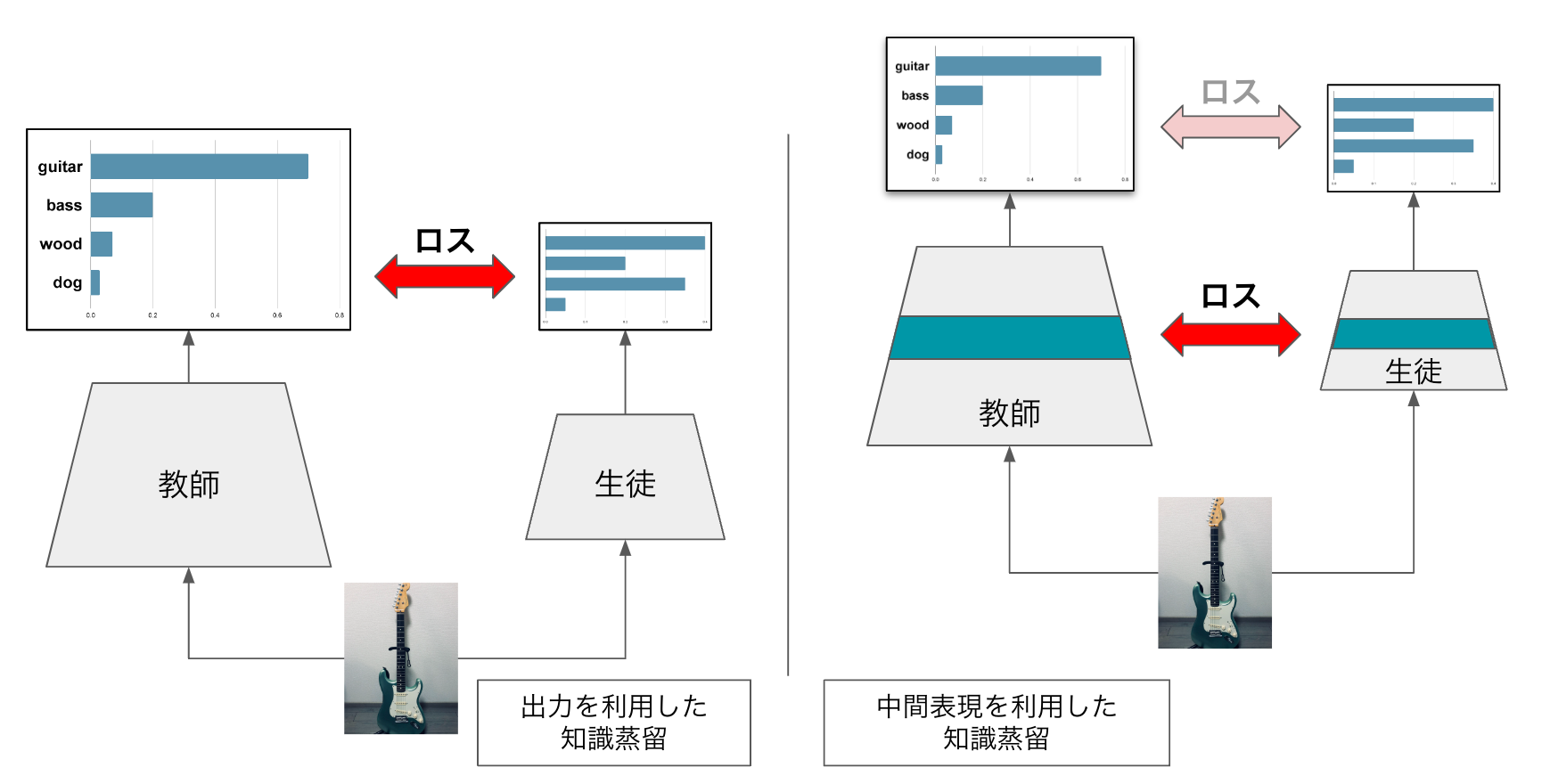

学習にはGPUを用いて一日程度の時間をかけています。また学習には数万枚の画像データを用いましたが、データの学習方法を工夫することで、画像データに人間が詳細なアノテーションをしたのはそのうち数百枚程度に抑える事ができました。

ディープラーニングを用いたアイテムの認識と取れる位置の認識

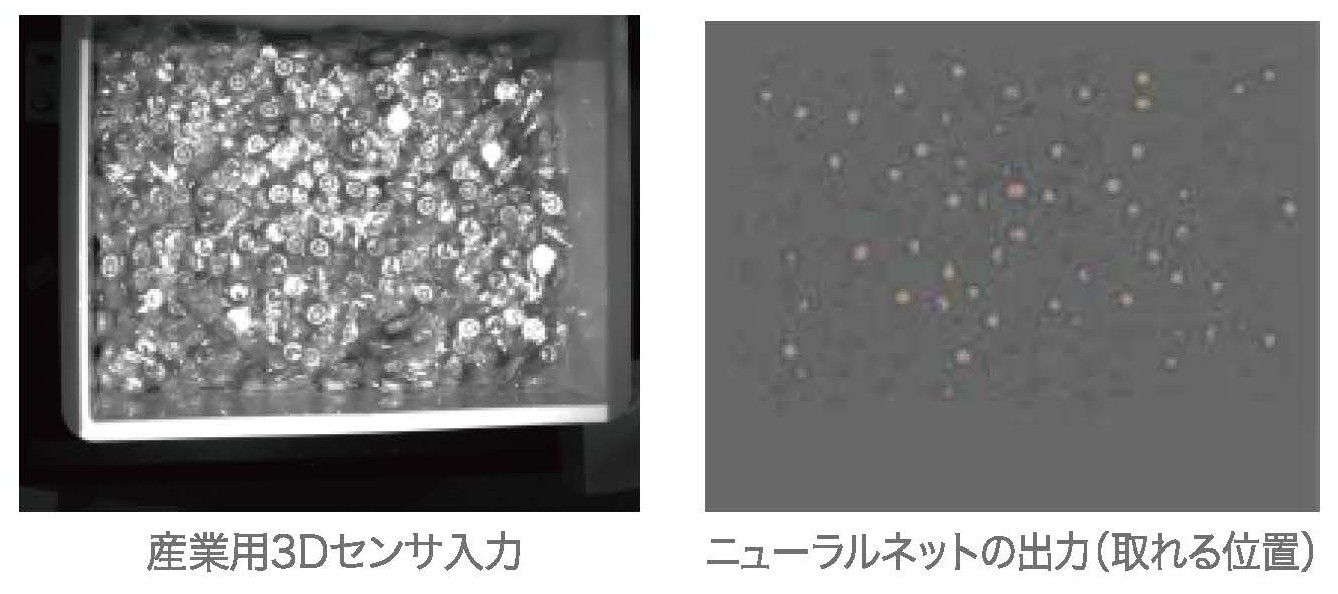

- キャンディ配りロボット

以前開発したバラ積みロボットの0から学習は学習データを実機で収集していましたが、今回のキャンディ配りロボットでは、画像から人間が取れそうな位置を教える事でバラ積み取り出しが出来る技術を用いています。こちらも人間によるアノテーションの労力は抑えつつ、9割を超える高いピッキング能力を学習させることが出来ました。

まとめ

今回、ピッキングをテーマにAmazonPickingChallengeに参加したロボットとバラ積み取り出しロボットを展示しました。ピッキングはロボティクスにおいて非常に重要な課題であり、既に実用化されているバラ積みロボットから、最先端の課題と言えるAmazonPickingChallengeまで、幅広い問題領域があります。我々は機械学習技術を用いたピッキング技術の高度化に取り組むことで、ロボットの応用範囲を広げて行けると考えております。また、ロボティクスの発展は少子高齢化の進む日本において、大きな社会貢献につながる事と思います。

Area